Anthropic a tűzvonalban: Kiberháború, Pentagon-viszály és a Claude-leállás háttere

Hogyan vezetett az MI-etika és a katonai szükséglet az Apple App Store élére és globális technikai összeomláshoz?

A mesterséges intelligencia globális ökoszisztémája 2026 elején egy olyan kritikus metszéspontba érkezett, ahol a technológiai fejlődés üteme, az etikai korlátok és a nemzetbiztonsági érdekek elkerülhetetlenül összeütköztek. Ebben a feszült környezetben a 2026. március 2-án bekövetkezett globális Anthropic-leállás nem csupán egy technikai hiba volt, hanem egy komplexebb, rendszerszintű válság tünete. Elemezzük a március 2-i eseményeket, azok technikai hátterét, az Anthropic és az amerikai védelmi minisztérium közötti példátlan diplomáciai szakadékot, valamint azt a paradoxonnak tűnő helyzetet, amelyben a vállalat egyszerre néz szembe a kormányzati feketelistára kerüléssel és a fogyasztói piacokon elért elképesztő népszerűséggel.

A 2026. március 2-i rendszerleállás elemzése

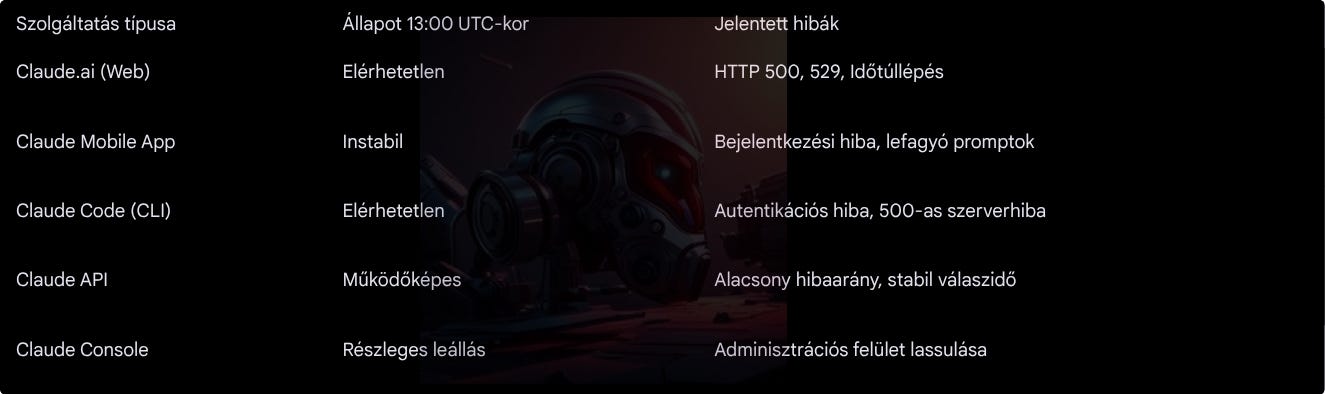

2026. március 2-án, 11:49 UTC-kor az Anthropic hivatalosan megerősítette, hogy a Claude.ai platform, a fejlesztői konzol és a Claude Code eszköz jelentős hibaarány-növekedést tapasztal. A leállás mértéke és időzítése különösen érzékeny volt, mivel szinte percekkel azután következett be, hogy a Claude alkalmazás az Apple App Store ingyenes toplistájának élére került. A felhasználók globálisan HTTP 500-as és 529-es hibakódokat tapasztaltak, amelyek a rendszer teljes elérhetetlenségét vagy súlyos túlterheltségét jelezték.

A technikai vizsgálat feltárta, hogy a hiba gyökere az autentikációs útvonalakban (login és logout folyamatok) rejlett. Ez a megállapítás rávilágít arra a stratégiai szétválasztásra az Anthropic architektúrájában, amely lehetővé tette, hogy a programozott API-hozzáférés (api.anthropic.com) nagyrészt érintetlen maradjon, miközben a webes és mobil felületek teljesen megbénultak. Ez a szeparáció kritikus fontosságú a vállalati partnerek számára, hiszen az integrált üzleti alkalmazások tovább működhettek, minimalizálva a gazdasági veszteségeket, miközben az egyéni felhasználók és a fejlesztők, akik a Claude Code CLI (parancssori felület) eszközére támaszkodtak, teljesen kiestek a munkafolyamataikból.

Az elemzés rámutat arra, hogy a 529-es hibakód (Overloaded Error) megjelenése közvetlen összefüggésben állt a hirtelen megugró forgalommal. A Claude népszerűségének robbanásszerű növekedése, amelyet a Super Bowl LX során bemutatott reklámok és a konkurens OpenAI kormányzati megállapodása miatti negatív kampány táplált, olyan terhelést rótt az infrastruktúrára, amelyet a hitelesítési szerverek nem tudtak elviselni. Az incidens során a DownDetector adatai szerint a jelentések csúcsa meghaladta az 5000 egyidejű panaszt, ami az Anthropic történetének egyik legintenzívebb felhasználói visszajelzési hulláma volt.

A hiba elhárításának idővonala és mechanizmusa

Az Anthropic mérnöki csapata gyorsan reagált, 11:49 UTC-kor adták ki az első Investigating (Kivizsgálás alatt) értesítést. 12:21 UTC-re azonosították, hogy a probléma a Claude.ai előlapi szolgáltatásait és a munkamenet-kezelő rendszereket érinti. A javítás implementálása 13:22 UTC-kor kezdődött, és a szolgáltatás fokozatos helyreállítása után 15:47 UTC-re nyilvánították a rendszert teljesen működőképesnek. Ez a közel négyórás kiesés komoly termelékenységi válságot okozott a Claude Code-ot használó fejlesztői közösségben, ahol a mesterséges intelligencia asszisztens mára a napi munkafolyamatok szerves részévé vált.

Az esemény mélyebb elemzése során látható, hogy a hiba elhárítása során alkalmazott canary release1 stratégia okozott némi zavart a felhasználók körében: egyes terminálablakokban a Claude Code már működött, míg másokban továbbra is 500-as hibát adott, attól függően, hogy a felhasználó kérése melyik frissített Kubernetes konténerbe futott be. Ez a modern elosztott rendszerek sajátossága, ahol a frissítések fokozatosan terjednek el a globális klaszterben, hogy elkerüljék a teljes rendszer összeomlását egy esetleges hibás patch esetén.

Infrastrukturális instabilitás: A 326 leállás mintázata

A március 2-i esemény nem elszigetelt eset, hanem egy aggasztó trend csúcspontja. Az Anthropic infrastruktúrája 2025 januárja óta 326 alkalommal tapasztalt különböző mértékű üzemszünetet vagy minőségromlást. Ez a megbízhatósági statisztika rávilágít azokra a kihívásokra, amelyekkel egy gyorsan skálázódó AI-cégnek szembe kell néznie a felhőalapú korszakban.

Különösen a 2026. februári adatok mutatnak extrém ingadozást. Február 17. és 24. között egy súlyos, több modellt érintő hiba jelentkezett, amely közel hét napig tartott, és jelentősen korlátozta a fájlfeltöltést, a kódgenerálást és az általános válaszminőséget. Ez az időszak rávilágította arra, hogy az Anthropic architektúrája mennyire érzékeny a komplexebb modellek, mint a Claude Opus 4.6 és a Sonnet 4.5/4.6 bevezetésére.

Az infrastrukturális problémák mögött meghúzódó egyik legérdekesebb technikai részlet a 2025 augusztusában feltárt context window routing error (kontextus-ablak útvonalválasztási hiba) volt. Ekkor a rendszer tévesen olyan szerverekre irányította a rövid promptokat, amelyeket az 1 millió tokenes kontextus kezelésére optimalizáltak. Mivel ezek a szerverek nem voltak hatékonyak a rövid kérések feldolgozásában, a felhasználók érthetetlen karaktereket, inkonzisztens válaszokat és lassulást tapasztaltak. Ez a hiba rávilágít az MI-alapú szoftverek skálázásának egyedi nehézségére: a hardver-optimalizáció annyira specifikus a modell paramétereire nézve, hogy a legkisebb logikai hiba az erőforrások elosztásában katasztrofális minőségromláshoz vezethet.

Az 500-as és 529-es hibák háttere

A március 2-i leállás során látott hibakódok mélyebb betekintést engednek az Anthropic infrastruktúrájának állapotába. A HTTP 500 (Internal Server Error) egy általános hiba, amely azt jelzi, hogy a szerver nem tudta feldolgozni a kérést egy nem részletezett belső hiba miatt. Az Anthropic esetében ez gyakran az elosztott mikroszolgáltatások közötti kommunikációs zavarra vagy adatbázis-elérési hibára utal a hitelesítési folyamat során.

Ezzel szemben az 529-es hiba (Overloaded Error) specifikusan az MI-szolgáltatásokra jellemző. Ez akkor jelentkezik, ha az API-végpontok túl sok kérést kapnak rövid időn belül, és a rendelkezésre álló GPU-kapacitás nem elegendő a válaszadásra.

A megbízhatósági kérdések különösen fontossá válnak, ahogy az MI-asszisztensek a kísérleti státuszból kritikus infrastruktúrává válnak. A Microsoft belső MI-csapatai is Claude Code-ot használják bizonyos fejlesztési feladatokhoz, ami azt jelenti, hogy az Anthropic instabilitása közvetlen hatással van a technológiai óriások saját fejlesztési ciklusaira is. Ez egy olyan kölcsönös függőségi hálót hoz létre, amelyben a felhőalapú MI-szolgáltatások megbízhatósága a globális gazdaság egyik alapkövévé válik.

A geopolitikai törésvonal: Anthropic vs. Pentagon

A technikai problémák mellett az Anthropic egy példátlan kormányzati konfliktus középpontjába került 2026 február végén. Donald Trump elnök és Pete Hegseth hadügyminiszter (Department of War) nyílt hadjáratot indított a vállalat ellen, miután az Anthropic megtagadta bizonyos etikai biztonsági korlátok (guardrails) eltávolítását a Claude modellből katonai célú felhasználás esetén.

A biztonsági viták és a Vörös Vonalak

A konfliktus lényege az Anthropic által képviselt Constitutional AI (Alkotmányos MI) alapelveiben rejlik. A védelmi minisztérium követelte, hogy a Claude modell álljon rendelkezésre minden jogszerű célra, korlátozások nélkül. Az Anthropic vezérigazgatója, Dario Amodei azonban két konkrét területen nem volt hajlandó kompromisszumot kötni:

Belföldi tömeges megfigyelés: A cég megtagadta, hogy technológiáját az amerikai állampolgárok válogatás nélküli, tömeges megfigyelésére használják fel.

Autonóm fegyverrendszerek: Az Anthropic fenntartja, hogy a mai MI-modellek nem elég megbízhatóak ahhoz, hogy közvetlenül irányítsanak olyan fegyvereket, amelyek emberi jóváhagyás nélkül hoznak élet-halál döntéseket.

Stratégiai feszültség és technológiai szuverenitás

A mesterséges intelligencia (MI) integrációja a globális biztonságpolitikai architektúrába 2026 elejére elérte azt a kritikus tömeget, ahol a technológiai innováció és az állami kényszer közötti súrlódások már nem csupán elméleti, hanem közvetlen egzisztenciális fenyegetést jelentenek a szektor meghatározó szereplőire. Az Amerikai Egyesült Államok újonnan átnevezett Hadügyminisztériuma (Department of War), az OpenAI és az Anthropic közötti tárgyalássorozat rávilágított egy alapvető problémára: a technológiai vállalatok már nem csupán beszállítói, hanem etikai és operatív kapuőrei a modern hadviselésnek. Azt a folyamat, amely során az OpenAI pragmatikus reálpolitikája és az Anthropic etikai alapú ellenállása ütközött a Trump-adminisztráció

Az Anthropic érvelése szerint az MI-rendszerek kiszámíthatatlanul viselkedhetnek új szituációkban, ami fegyveres konfliktus esetén baráti tűzhöz, a misszió kudarcához vagy nem várt eszkalációhoz vezethet. Ezzel szemben a Pentagon álláspontja az volt, hogy a magánvállalatok nem szabhatják meg a hadseregnek, hogyan használják a törvényes keretek között beszerzett eszközöket. Pete Hegseth hadügyminiszter cowardly corporate virtue-signaling-nek (gyáva vállalati erényfitogtatásnak) nevezte az Anthropic hozzáállását, és azzal vádolta a céget, hogy a szilícium-völgyi ideológiát az amerikai életek fölé helyezi.

A Supply Chain Risk megbélyegzés és jogi következményei

2026. február 27-én, miután az Anthropic nem teljesítette az 5:01 PM ET-kor lejáró ultimátumot, a Pentagon hivatalosan is nemzetbiztonsági szempontból ellátási lánc kockázatnak (Supply Chain Risk to National Security) minősítette a vállalatot. Ez a besorolás, amelyet korábban szinte kizárólag olyan külföldi ellenséges entitásokra alkalmaztak, mint a Huawei vagy a Kaspersky, drasztikus következményekkel járt.

Az elnöki direktíva alapján:

Minden szövetségi ügynökségnek azonnal be kell szüntetnie az Anthropic technológiáinak használatát.

Az Anthropic elvesztette a Pentagonnal kötött, mintegy 200 millió dollár értékű szerződését.

Bármely vállalat, amely az amerikai hadsereggel üzletel, elvileg el van tiltva attól, hogy az Anthropic-kal bármilyen kereskedelmi tevékenységet folytasson.

Ez utóbbi pont különösen veszélyes az Anthropic számára, hiszen legnagyobb befektetői és partnerei – az Amazon, a Google és a Microsoft – mindannyian hatalmas védelmi beszállítók. Dean Ball, a korábbi elnöki MI-tanácsadó, a lépést megkísérelt vállalati gyilkosságnak nevezte, rámutatva, hogy ha a tiltást szigorúan alkalmazzák, a tech-óriások kénytelenek lesznek megválni az Anthropic-ban lévő részesedésüktől, ami destabilizálhatja a vállalat finanszírozását.

Katonai műveletek és kiberháborús retorzió: Az iráni szál

A március 2-i leállás technikai okai mögött felsejlik az egyidejűleg zajló iráni-amerikai konfliktus, az Operation Epic Fury hatása is. Bár Donald Trump elnök február 27-én elrendelte az Anthropic-szolgáltatások azonnali beszüntetését, a katonai realitások és a rendszerek mély beágyazottsága miatt egy hat hónapos kivezetési időszak lépett életbe.

A Claude szerepe az Operation Epic Fury-ban

Megerősített jelentések szerint az amerikai Központi Parancsnokság (CENTCOM) a hivatalos tiltás ellenére is aktívan használta a Claude-ot a február 28-án indított iráni légicsapások során. A modellt hírszerzési elemzésekre, célpontok azonosítására és harctéri szimulációkra alkalmazták. Ez a misszió-kritikus használat egy olyan időszakban rótt extra terhelést az Anthropic infrastruktúrájára, amikor a vállalat éppen a kormányzati tiltás és a felhőszolgáltatókkal való kapcsolatának bizonytalansága miatt küzdött. Az OECD.AI jelentése szerint a Claude közvetlenül hozzájárult a halálos kimenetelű műveletek sikeréhez, ami etikai dilemmát teremtett a cég biztonsági vállalásai és a tényleges harctéri alkalmazás között.

Iráni kiber-retorzió: The Great Epic

A technikai leállás időzítése egybeesett az iráni állami és hacktivista csoportok által indított válaszcsapásokkal. Az iráni kibererők The Great Epic néven indítottak kampányt, amely kifejezetten az amerikai technológiai infrastruktúra és a katonai beszállítók ellen irányult.

DDoS támadások: Kiberbiztonsági megfigyelők, mint a CrowdStrike, a konfliktus kirobbanása után azonnal az elosztott szolgáltatásmegtagadással járó (DDoS) támadások megugrását észlelték.

Hitelesítési zavarok: Bár az Anthropic hivatalosan autentikációs hibát jelölt meg okként, a jelentett 500-as és 529-es hibák, valamint a bejelentkezési utak (authentication paths) zavara tipikus tünetei egy intenzív külső túlterhelésnek vagy célzott zavarkeltésnek.

A leállás tehát egy tökéletes vihar eredménye: a katonai műveletekben való közvetlen részvétel, az iráni kiber-retorzió és a Pentagon-vita miatt megugró lakossági forgalom együttesen vezettek az autentikációs rendszerek összeomlásához.

Piaci dinamika: Az App Store győzelem és a szolidaritási hullám

Míg a washingtoni elit ellenségként kezelte az Anthropic-ot, a lakossági és fejlesztői piacon a cég népszerűsége az egekbe szökött. 2026. március 1-jén a Claude alkalmazás elfoglalta az 1. helyet az amerikai Apple App Store ingyenes listáján, letaszítva az OpenAI ChatGPT-t a trónról.

A Katy Perry-effektus és a fogyasztói etika

A hirtelen népszerűség-ugrás részben a geopolitikai feszültségnek köszönhető. Amikor híre ment, hogy az Anthropic nemet mondott a Pentagonnak a tömeges megfigyelés és az autonóm fegyverek kérdésében, a közösségi médiában (Reddit, X) hatalmas támogatási hullám indult el. A felhasználók a ChatGPT előfizetéseik lemondására és a Claude-ra való áttérésre buzdítottak, az Anthropic-ot az etikus MI bajnokaként beállítva.

A szolidaritási hullám egyik leglátványosabb pillanata Katy Perry posztja volt az X platformon. Az énekesnő megosztott egy képernyőfotót a Claude Pro éves előfizetéséről ($214.99), egy kézzel rajzolt szívvel a gomb körül, és a done (kész) felirattal. A poszt több mint 3,4 millió megtekintést ért el, és katalizátorként hatott a fiatalabb generációk körében, akik számára az etikai szempontok elsődlegesek a technológiaválasztásnál.

Vállalati adoptáció: A Microsoft és a Multi-Cloud Stratégia

Bár a kormányzati tiltás ijesztő, az Anthropic gazdasági motorja a vállalati (B2B) szektorban dübörög. 2025 közepére a vállalat megduplázta részesedését az üzleti LLM-piacon, elérve a 24%-ot, miközben az OpenAI részesedése 34%-ra csökkent. Ez a növekedés annak köszönhető, hogy az Anthropic a biztonságot és a megbízhatóságot tette meg fő hívószónak a szabályozott iparágakban (egészségügy, pénzügy).

A Microsoft 500 millió dolláros éves költése

Az egyik legmeglepőbb fejlemény az Anthropic és a Microsoft közötti kapcsolat elmélyülése. Bár a Microsoft az OpenAI legfőbb támogatója, jelentések szerint 2026-ban már évi 500 millió dollárt költ arra, hogy az Anthropic modelljeit elérhetővé tegye az Azure ügyfelei számára. Ez a stratégia lehetővé teszi a Microsoft számára, hogy MI-szupermarketként funkcionáljon, ahol az ügyfelek választhatnak az OpenAI, az Anthropic és a Mistral modelljei között, anélkül, hogy elhagynák az Azure ökoszisztémáját.

Konklúzió: Az Anthropic jövőképe a bizonytalanságban

Az Anthropic jelenlegi helyzete a mesterséges intelligencia iparág egyik legizgalmasabb és legveszélyesebb esettanulmánya. A vállalat egy olyan egyedi pozíciót foglalt el, ahol a technikai sebezhetőség és a geopolitikai elszigetelődés paradox módon egyfajta erkölcsi felsőbbrendűséggé alakult a fogyasztók szemében.

A március 2-i leállás tehát egyfajta ébresztő volt: emlékeztetett minket arra, hogy az MI még mindig egy törékeny, fejlődésben lévő technológia, amely egyszerre függ a fizikai valóságtól (energia, GPU-k) és a politikai akarattól. Az Anthropic sorsa megmutatja, hogy a biztonság mindenekelőtt filozófia életképes üzleti modell maradhat-e egy olyan világban, ahol a technológia a hatalom és a háború legfőbb eszközévé vált.

A canary release (vagy canary deployment) a szoftverfejlesztésben és DevOps-ban egy olyan kockázatcsökkentő bevezetési stratégia, amely során az új szoftververziót vagy funkciót nem egyszerre teszik elérhetővé az összes felhasználó számára, hanem először csak egy kicsi, korlátozott felhasználói csoportnak (a “kanárinak”) teszik elérhetővé.